在当今数据驱动的时代,大数据技术已成为驱动企业决策与创新的核心引擎。无论是海量数据的存储、处理,还是从中提取有价值的信息,都离不开强大的大数据开发与服务能力。要想在这个领域深耕并取得成功,构建一个坚实、全面的基础至关重要。本文将系统阐述学好大数据开发与服务所需的关键基础,为有志于此的学习者提供清晰的路径指引。

一、坚实的计算机科学基础

大数据开发并非空中楼阁,它深深植根于传统的计算机科学知识体系之中。

- 编程能力:这是最基本的工具。至少熟练掌握一门主流编程语言,如 Java 或 Python。Java因其在企业级应用和Hadoop生态中的广泛使用而尤为重要;Python则因其简洁的语法和在数据分析、机器学习领域的强大库(如NumPy, Pandas, Scikit-learn)而备受青睐。Scala作为Spark的原生语言,也值得深入学习。

- 数据结构与算法:处理海量数据时,高效的算法和恰当的数据结构是保证性能的关键。理解排序、查找、图算法以及时间/空间复杂度分析,能帮助你在设计数据处理流程时做出最优选择。

- 操作系统(尤其是Linux):大数据集群通常部署在Linux系统上。熟悉Linux常用命令、文件系统、进程管理和Shell脚本编写,是进行环境部署、运维和故障排查的必备技能。

- 计算机网络:理解网络协议(如TCP/IP)、分布式系统通信原理,对于理解大数据框架的分布式架构和调优至关重要。

二、深入的分布式系统原理理解

大数据技术的本质是分布式计算与存储。不理解其底层原理,就无法真正掌握和优化大数据应用。

- 核心概念:必须深入理解分布式存储、分布式计算、容错性、一致性(如CAP定理)、数据分片、任务调度等核心思想。

- 框架原理:不仅要会用Hadoop、Spark、Flink等框架,更要了解其架构设计和工作原理。例如,MapReduce的计算模型、Spark的RDD和DAG执行引擎、Flink的流处理理念等。

三、大数据技术栈的体系化掌握

这是一个从存储、计算到资源管理的完整生态。

- 存储层:

- HDFS:Hadoop分布式文件系统,是大数据生态的基石,必须掌握其架构、读写流程和常用操作。

- NoSQL数据库:根据场景学习不同的数据库,如列式存储的HBase、文档数据库MongoDB、键值数据库Redis等。

- 数据仓库:了解Hive(将SQL转化为MapReduce/Spark任务)和数据湖概念。

- 计算层:

- 批处理:掌握 Hadoop MapReduce(理解原理)和 Apache Spark(核心API、性能调优)。Spark已成为批处理的事实标准。

- 流处理:学习 Apache Kafka(消息队列)以及流处理框架如 Apache Flink 或 Spark Streaming,以应对实时数据需求。

- 资源管理与调度:

- YARN:Hadoop的资源调度器,理解其如何为MapReduce、Spark等应用分配资源。

- 容器化技术:Docker和Kubernetes 正在成为新一代大数据平台部署和管理的标准,了解它们是大势所趋。

四、数据管理与处理能力

大数据开发不仅仅是写代码,更是对数据的全生命周期管理。

- SQL的极致掌握:SQL是数据领域的通用语言,必须能够编写复杂、高效的查询语句。对Hive SQL、Spark SQL的熟练使用是基本要求。

- 数据建模:理解数据仓库的建模理论,如维度建模(星型模型、雪花模型),能够设计出合理、高效的数据模型。

- ETL/ELT开发:这是大数据工程师的核心日常工作之一,即数据的抽取(Extract)、转换(Transform)、加载(Load)。需要熟练掌握相关工具(如Sqoop, DataX, Flume, Spark)和流程设计。

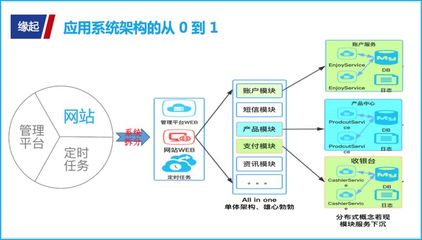

五、从“开发”到“服务”的思维拓展

“大数据服务”意味着更高层次的视角,要求开发者具备产品化和运维思维。

- 平台化与API化:能够将数据处理能力封装成稳定的、可复用的服务或API,供其他系统或业务方调用。

- 性能调优与故障排查:具备集群性能监控(使用Ganglia, Prometheus等)、日志分析、JVM调优、数据倾斜处理等高级能力,保障服务的稳定与高效。

- 数据治理意识:关注数据质量、元数据管理、数据安全与隐私(如脱敏、加密)、数据血缘追踪,确保数据服务的可靠性与合规性。

- 云计算集成:熟悉主流云平台(如AWS EMR, Azure HDInsight, 阿里云MaxCompute)的大数据服务,能够利用云原生能力快速构建和扩展数据平台。

六、持续学习与实践精神

大数据技术日新月异,框架迭代迅速。保持好奇心,紧跟社区动态(如Apache项目更新),并通过以下方式持续实践:

- 搭建个人实验环境:利用虚拟机或云服务器搭建小型Hadoop/Spark集群。

- 参与开源项目:阅读优秀框架的源码,尝试提交Issue或PR。

- 解决真实问题:通过Kaggle竞赛、公司项目或个人项目,用数据解决实际问题,这是检验和提升能力的最佳途径。

而言,学好大数据开发与服务,是一个从底层基础到上层应用、从单一技能到系统思维的构建过程。它要求从业者既是扎实的“工程师”,精通编程与系统原理;又是敏锐的“数据架构师”,善于设计数据流转与存储;最终成为可靠的“服务提供者”,保障数据价值的高效、稳定输出。这条道路充满挑战,但也因其巨大的社会与商业价值而前景广阔。夯实基础,勇于实践,方能在数据洪流中把握先机。